Googles neuronaler Synthesizer erzeugt völlig neue Sounds

Was bekommt man, wenn man eine Sitar, eine Marimba, einen Hund und ein Auto überquert? Erlauben Sie dem neuronalen Synthesizer von Google, ihn mit hunderten von Variationen in Klangfarbe, Tonhöhe und Klang zu spielen. Das neue Spielzeug des Unternehmens, das als NSynth Super bekannt ist, ermöglicht es Musikern, durch maschinelles Lernen nie zuvor gehörte Klänge und Pfoten an den Grenzen der computergestützten Kreativität zu erzeugen.

Die Arbeit ist Teil von Magenta, einem Forschungsprojekt, das unter Google Brain – Googles tief lernender künstlicher Intelligenz – angesiedelt ist und die Rolle des maschinellen Lernens bei der Schaffung von Kunst und Musik untersucht. Die NSynth-Forschung wurde erstmals im Mai 2017 detailliert und jetzt ist Google Open-Sourcing der Hardware-Spezifikationen und der Schnittstelle, damit jeder sein eigenes High-Tech-Instrument hacken kann. Google beschreibt den Nysnth Super als „Open Source Experimentalinstrument“.

Bisherige Vorstöße in die künstlich intelligente Musik waren in der Regel die Erzeugung von Melodien, um fehlende Stimmen zu liefern: Menschen haben Duette mit Computern gespielt, oder die fehlenden Instrumente eines Orchesters wurden ausgefüllt. Der NSynth-Algorithmus geht noch einen Schritt weiter, indem er es Musikern ermöglicht, völlig neue Klänge zu erzeugen. Mit Hilfe von tiefen neuronalen Netzen lernt es die Eigenschaften verschiedener Instrumente kennen und ist in der Lage, diese Teile zu neuen Ganzen zu verschmelzen.

Der Algorithmus kann auch erkennen, was jeden Klang einzigartig macht. „Im Prinzip haben wir zwei Klänge – den Klang einer Snare und den Klang eines Basses. Der Algorithmus erzeugt alle Klänge, die dazwischen liegen, aber er mischt sie nicht nur zusammen – er versteht die Qualität der Klänge, also wird er im Falle der Snare und des Basses einen Sound dazwischen erzeugen, der irgendwie den Angriff der Snare mit dem Hit hat, aber auch die Obertöne des Basses“, sagt João Wilbert, Creative Technology Lead im Google Creative Lab in London. Diese Fähigkeit, definierende Eigenschaften zu erhalten, erzeugt wirklich ungewöhnliche Klänge.

Der ursprüngliche Algorithmus wurde auf über 300.000 Instrumentenklänge trainiert und ist damit der mit Abstand größte öffentlich zugängliche Datensatz von Musiknoten. Magenta baute NSynth mit TensorFlow – Googles maschineller Lerntechnologie, die bereits im Jahr 2015 veröffentlicht wurde – und alle ihre Modelle und Tools sind ebenfalls Open Source und auf GitHub verfügbar.

„Wie machen wir es zugänglich, ohne viel Code zu benötigen, um es zu verstehen“, sagt Teamleiter Peter Semple. In der Vergangenheit hat das gleiche Team Project Bloks entwickelt, eine praktische Codierungsaktivität, die Bausteine verwendet, um die Taktilität der Kinder zu nutzen und sie dazu zu bringen, technologische Strukturen aufzubauen und zu sequenzieren.

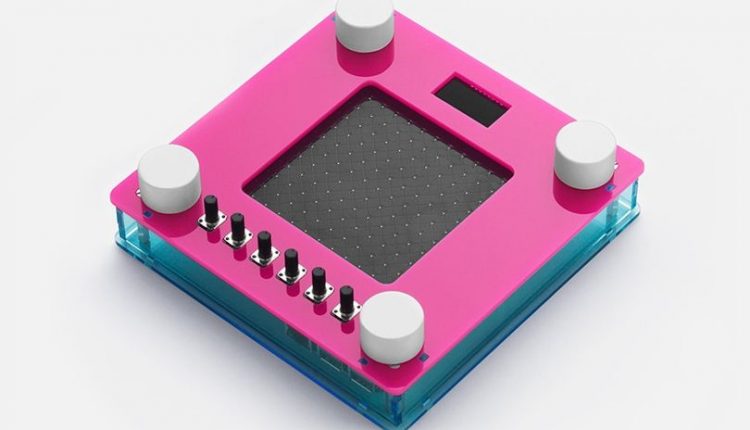

Hier wollten Wilbert und der Kreativtechniker Zebedee Pedersen ein Werkzeug bauen, das jeder nutzen kann. Sowohl Wilbert als auch Pedersen machen und spielen ihre eigene Musik und entwarfen den NSynth Super so, dass er billig zu bauen ist – er kann aus ein paar Plexiglasplatten, einigen 3D-Druckknöpfen an jeder Ecke und einem Raspberry Pi gebaut werden.

Der Benutzer kann sein eigenes, aufgenommenes’Soundpack‘ von 16 vorverarbeiteten Quellklängen hochladen und den Algorithmus seine Arbeit tun lassen, während er seine Finger über den Bildschirm zieht, um neue Akustik zu erzeugen, irgendwo innerhalb der Matrix der vier Quellklänge an jeder Ecke, indem er die Skalen benutzt, um den im Touchpad dargestellten Klangraum zu definieren. Dieses Touchpad wird wiederum auf einem analogen Bildschirm mit einer Karte von Punkten dargestellt, die als Reaktion auf die Bewegungen Ihres Fingers aufleuchten. Es wurde so konzipiert, dass es sich in bestehende Musikproduktionsmethoden einfügt, so dass Sie beispielsweise ein Keyboard mit einem MIDI-Instrument anschließen können.

Pedersen sagt, dass der Algorithmus den Klängen ihre eigenen körnigen Qualitäten verleiht und dass es den Musikern Spaß gemacht hat, sich mit den Grenzen und den neuen Möglichkeiten herumzuschlagen. Einem so klassischen Klang wie zum Beispiel dem Klavier eine seltsame neue Textur hinzuzufügen, war etwas, was der NSynth eröffnete. In Zukunft, so Wilbert und Pedersen, hoffen sie, die Technologie zu bauen, um Zwischentöne in Echtzeit zu erzeugen – aber sie ist noch nicht da und müsste Klänge mit einer sehr hohen Geschwindigkeit interpolieren.

Letztlich geht es darum, dass Menschen und Maschinen zusammenarbeiten und nicht miteinander konkurrieren. „Wir wollen nicht etwas schaffen, das die Musik erzeugt, die Noten selbst, denn das ist es, was ein Musiker tut. Wir wollten ihnen den ergänzenden Teil geben“, sagt Wilbert.